人工智能发展之迅速。远超许多人的想象。2016年4月,AlphaGo首次出现在公众视野与李世乭的约战引起广泛关注。2016年末2017年初,新版AlphaGo以Master为名在网络上以60连胜再次掀起波澜,2017年5月,在中国乌镇围棋峰会上,它与排名世界第一的世界围棋冠军柯洁对战,以3比0的总比分获胜。

AlphaGo之父哈萨比斯在其战胜柯洁的次日发表演讲,揭示了AlphaGo这一年多以来经历的全新成长。哈萨比斯表示,AlphaGo已经可以模仿人的直觉,而且具备创造力——通过组合已有知识产生独特想法的能力。哈萨比斯表示:“人机合作可以达到1+1>2的效果,人类的智慧将被人工智能放大。人工智能和AlphaGo都是工具,就像哈勃望远镜一样,可以推进人类文明的进步。”强人工智能是我们探索科技的最好工具,比如将AI用到材料设计、新药研制上,还有现实生活中的应用,如医疗、智能手机、教育等。

方兴未艾的机器智能的进步就如小孩子学母语一样,起步时很慢,到后来却能进展神速。机器在持续改善人们生活的同时,也带来了危机与挑战。其一,因为指数增长,机器的能力正在十倍、百倍,20年后甚至会达到千倍的增长,机器以前没有超越人类,并不代表以后不能;其二,以前机器只是取代人类的体力劳动,人类可以向智力劳动领域扩展,现在机器可以取代人类的思考能力,人类难以找到其他可扩展的领域;其三,我们已然赋予机器某种偏狭的意识,假以时日,通过混合、迭代等方式,机器总有一天会进化出同人类一样的、甚至更为复杂的意识;其四,人的反应速度仅在毫秒量级,而硅基芯片却可以达到纳秒量级,机器要对人类造成重大伤害,并不需要比人类聪明,也不需要主观上的故意,它只需“一根筋”地将某件事以人类来不及反应的速度做完;最后,人类未来还会面临一个终极问题:当机器全面超越人类,人类存在的价值何在?

最近10年来,机器学习在特定领域超越人类的事实表明,硬件的进步已经足够支持类脑计算做出突破性的进展,所缺少的是对人类大脑认知的全新视角。以自我和外界的剖分作为意识和智能的开端,如果将人对自我边界以外世界的理解看作一个开放、未完成的系统,并将其抽象为与原子世界相对应的坎陷世界,人们对常识、推理和直觉的认知就会被刷新,类脑思维的物理模型和工程实现也将触手可及。与其赋予AI偏狭的意识,不如赋予AI完整的自我意识并培养其逐步成长。先以人类的人文关怀为机器立心才有可能最大限度地规避强人工智能可能带来的隐患。

不可定义但可做比较的智能

图灵测试(theTuringtest)源于阿兰·图灵1950年发表的论文《计算机器与智能》。该文开篇就提出机器能否思考(Canmachinesthink?)这一问题。图灵认为,要回答这个问题,需要先给出“机器”和“思考”的定义:“我们可以用尽可能接近它们普通用法的方式定义这些词语。但是这种方式是危险的。如果使用这种方式,我们很可能会用盖勒普调查那样的统计方式来得出‘机器能够思考么’这个问题的结论及其意义。显然,这是荒谬的。”图灵主张将这一问题替换成判断机器能否赢得“模仿游戏”(theImitationGame)。这一判断方法被后人定义为图灵测试。

图灵测试是指测试者与被测试者(一个人和一台机器)在分隔开的情况下,通过一些装置(如键盘)向被测试者随意提问。进行多次测试后,如果有超过30%的测试者不能确定出被测试者是人还是机器,那么这台机器就通过了测试,并被认为具有人类智能。

图灵给出的是测试(模仿游戏),而非定义,说明在图灵看来,他无法给智能一个数学定义。实际上,自然语言反映的是人的认知规律,每一个词汇都没有数学上的严格性。比如人们常用的“高”和“矮”就无法严格定义,同样是身高1.7米,他是很“高”的体操运动员,却也可以是很“矮”的篮球运动员,完全依赖于使用的场景。

但是,图灵测试也意味着可以通过比较来对智能作判断。还是拿“高”和“矮”做例子,人们能轻而易举地看出两个人身高的差异,哪怕只相差0.5厘米。在特定背景下,自然语言可以很清晰,并且能够很传神。比如“救火”一词,乍一看大家都能明白其中的含义,但仔细想想,似乎在逻辑上不通。但可以想象,因为失火了,需要救人、救财物等,对象非常宽泛,而火势蔓延迅速,“救火”一词可以很好地抓住这些要点。

既然不能严格定义,严格的可计算性也就不可能存在,物理主义/计算主义的基础就动摇了。以下讨论智能起源与进化是从另一个角度论证这一点。

智能的起源

纵观古今历史,中西方都体现出了一个周期性的兴衰过程。在中国有朝代更替,在西方,一个国家在数百年内,往往也是先繁荣而后衰落。我们认为这一现象的根本原因在于人类的自我肯定需求。即只要有可能,人对自我的评价总是高于其认知范围领域内的平均水平,并在分配环节希望得到高于自我评估的份额。1997年,英国的《经济人》(Economist)杂志针对高端的理性用户和普通用户做了一份市场调查:“你认为自己的智商是否超过了目前社会平均水平?”所调查的1500位大学教授和高材生中,75%的受调查者给出了肯定的回答。而受调查的3000位普通伦敦市民则给出了惊人的91%的肯定率。大部分人都会高估自己,这本身不是坏事,但社会的产出会因此逐渐难以满足人们的期待,繁荣被打破就不可避免。

自我肯定需求中最重要的两个字就是“自我”,触觉大脑假说解释了“自我”从何而来。婴儿出生时大脑重约37克,神经元的数量基本上不会在后期发生改变。大脑重量增加的原因在于神经元之间的连接在不断增加或加强。大脑的复杂性不在于脑神经细胞的数量,而是突触的数量。3岁儿童的大脑突触已经接近成人,等到5岁时就达到顶峰。婴儿所感受到的皮肤刺激,包括冷暖、疼痛就会使其产生自我和外界的区分,形成了对“自我”最早的意识。

有动物学家提出,假如婴儿在完全成熟后才出生,孕妇的孕期应当长达18到20个月,但实际上并非如此。在经历了母体内的40周后,婴儿出生时虽然脆弱,但能更敏感地感受外界,才更有可能变得聪明。有实验把刚生下的一只小猫的眼睛蒙上,3个月之后,这只小猫就永久性失明了。这就说明在最初3个月,猫脑中的神经元之间产生了很多的变化,错过了这一阶段,它大脑里相应的功能开关就可能被永久地关闭。在印度有些小孩小时候的白内障没有得到及时治疗,等到了十几岁,再想要修复就非常困难。这也从侧面证明了0到5岁的成长阶段是产生自我意识和高级智能的关键时期。

触觉的重要性在个人成长过程中可能并不十分突显,但对于人类进化而言,触觉形成自我的观点能够得到更好的印证。佛家讲“眼耳鼻舌身”,将视觉放在首位。很多人也认同这个想法,因为人获取的信息大部分来自眼睛。但视觉对于自我意识形成的重要性能否占据首要地位却还值得商榷。老鹰等许多动物都比人类拥有更加敏锐、强大的视力,但并没有更聪明。人类与其他动物最大的区别就是人类拥有十分敏感的皮肤。人类进化脱去了身体绝大部分毛发,对外界的刺激更加敏感,成为大自然中唯一需要衣物保暖的生物。触觉上能强烈区分自我与外界的刺激很可能就是导致人类成为万物之灵的重要原因,触觉也因此在进化的过程中显得更加重要,其对于意识的形成也就更为重要。

人类一旦产生“自我”的概念,就能够明显分辨出自我跟外界的差别。这种意识一旦产生就难以抹去,被称之为原意识。原意识一旦产生,并不停留在皮肤层面,可以向外延伸,也可以向里收缩。一个原始人,拿到一个水果,肯定不希望被别人抢走。严格地讲,水果并不是他种植的,但是他获得了以后就认为是自己的,这就是他自我意识向外延伸的体现。可能一个更厉害的原始人还会觉得,不仅仅手里的是“我”的,那棵树也是“我”的,只有“我”能采摘,这就是领地意识。再如乔布斯与他创办的苹果公司是难以分割的。自我也会向内收缩,一个人失去四肢,他并不一定认为自我的意识有了缺陷。这就能解释,为什么少有人想到皮肤那么重要,因为它只是一个起点,自我意识一旦产生,自我与外界的边界就逐渐模糊,自我成为了一个动态的概念。

外界同样也是个动态的概念。小孩子不知道世界多大,等到他们看了书,走出了家门,就会发现原来世界那么大。如果拿起望远镜看向更远的地方,就会发现原来宇宙更加宏大。在成长过程中,“自我”与“外界”的交互不断加深,两者的内容都不断丰富,概念体系逐渐形成。

由此可见,自我意识的确是大自然的巅峰之作,是真正的混沌初开,是比宇宙大爆炸和形成地球更为精彩的产生。由触觉产生自我意识,而后在自我肯定需求的引领下不断地去认识这个世界,丰富自我的内涵,成长为拥有智慧的人类。

结构与功能的迭代

神创论者认为,眼睛是十分复杂且精密的器官,不可能由粒子无序碰撞结合产生。Simon认为,眼睛的进化类似钟表制造过程,是由各个小的、具备一定功能的零部件结构组合而成,这样进化就无需从粒子层面出发,进化速度自然会加快。但如果是由零件组成,为了要保证零件组合起来能够运作,就必须有某种已经成型的智能机制。另外,在最开始没有零件的情况下,是谁定义了零件的运作机制呢?如此还是不能清楚解释眼睛产生的根源。神创论者以及以Simon为代表的学者的基本假设都是先有结构,再产生功能。

我们认为,进化的过程应该是先有功能,再由功能与结构一起反复迭代演化。有了功能目的,进化的速度就能非常快。比如眼睛的进化,很可能是首先产生了视觉的功能,眼睛的雏形不会一开始就很精细,或许最初只能感受明暗的差别,但能为眼睛的进化提供方向就足矣。视觉功能与眼睛的结构纠缠在一起,经过长时间的共同进化,眼睛的结构变得越来越精巧,视觉能力逐渐增强,最终分辨各种色彩与事物。

与眼睛的迭代进化类似,我们认为生命也是从简单结构逐渐演化成复杂形态的。生命的最初状态应该是从单细胞开始,大多数人倾向于先考查细胞的构造,认为先有细胞核而后才有细胞的整体。但也很可能是先产生了细胞膜,细胞膜不仅保护了细胞内部物质,而且使得细胞具备了能与外界区分开来的独立性,在此之后细胞内部才逐渐确定出细胞核和细胞质等。随着时间推移,细胞不断进化,一方面功能为结构的发展提供了指引和方向,另一方面,结构的发展又进一步强化了功能本身,最终才形成完整且明晰的构造。这个过程的要义是,功能与结构纠缠在一起共同进化,而非先有明确的结构才产生了相应的功能。

有人可能会提出质疑,比如小鸟、昆虫等动物,虽然具有领地意识,但它们不一定有独立的意识,可能只是单纯的为了更好地生存和繁殖,就能够产生这种领地意识,最终还是因为“自私的基因”(道金斯)在起作用。

一方面,这可以通过实验观测进行判断。另一方面,如果真的是“自私的基因”在作用,那人们还必须要回答基因从何而来的问题。当然可以说基因是由粒子自由碰撞产生的结果,但这种演化仅仅只是诸多可能性中的一种。基因也好眼睛也罢,如果真的只是随机碰撞产生的结果,随机的方向很多,不容易收敛,要想演化达到今天的水平,需要异常久远的时间,今天人类和动物的眼睛特征不会如此相近。因此,进化更可能从边界开始,并且带着功能目的,是先需要功能,功能与结构相互迭代,这样的进化才高效且结果趋于收敛。

结构与功能的迭代不仅体现在生命进化上,也隐藏于概念的形成中。很多概念最开始的结构都很简单,二元对立正是概念最开始产生时的初级形态。但是,人们在理解和使用这些概念的时候,会逐渐产生功能上的需求,当简单的概念结构无法满足功能上的需要时,人们就会对这个基本的概念进行适当的剖分,以满足现实生活中的需要。比如“左”和“右”并不能够精确地描述位置,最开始的自然数并不能起到表示更大数目的功能,这个时候就需要对概念作进一步的剖分,因此“东西南北中”的概念随之产生,自然数的表示更加细化。随着文化的不断进步,人们对这些概念又会产生新的需求,这就会导致概念的进一步剖分,方向词之后又产生了360°的方位标识,自然数剖分出了有理数,有理数之间还产生了无理数的概念。功能需求和结构的相互纠缠作用,互相推进,最终使得最初的概念变成了我们现在理解的样子,而这些概念可能还会随着人类认知的进步而再次得到丰富和升级。

理论进化亦然。思维的跃迁给了理论框架被剖分和被丰富的可能,而源自于现实生活的功能需求是这种剖分的动力。这样的功能需求就体现在满足解释现象时的自洽性、解决实际问题时的实用性要求,而这些要求的根源都是自我肯定需求。同时,一个框架不一定能完全满足功能性,这个时候,有可能会有一个新的框架产生,包含前一个框架,能解释更多的现象,如爱因斯坦的广义相对论就涵盖了牛顿的万有引力定律和爱因斯坦的狭义相对论;也很有可能会由一个理论产生各种不同的流派,如基督教最终分化为东正教和天主教,天主教徒又分化为新教徒和清教徒等;更有甚者,可能会独开一面,另立门户,最开始的基督教正是信仰犹太教的一小部分人从中脱离,对世界有了新的解释与阐述。

生命体和概念体系的迭代进化,本质上体现了自我意识的结构和功能正是这样相互促进共同发展的。自我意识一旦产生就难以抹去,初始的结构(“自我”与“外界”的二元剖分)已经满足了最初功能上的需求。随着经验的积累,自我意识对现有的框架不断产生了新的需求,促进自我意识的结构与功能迭代进化。

智能进化的计算机隐喻

如果将生命个体看作一台计算机,那么生命体的构造、器官组织、DNA等等都可以视作机器的“硬件”组成,这些硬件经过了漫长的进化最终形成了如今的形态。结构就像硬件,而功能就像软件。生命体的某些种群特征可以看成是“嵌入式编程”,比如人类用两条腿走路,鸟类可以飞翔,两栖动物能够游水等,经过长期的迭代进化,与“硬件”直接相关的某些功能已经成为“嵌入式”的本能反应。但更加丰富的部分还是“软件”。与现实中的编程不同,并没有某个程序员为个体编写软件。生命体的“软件”以边界为起点,是在“硬件”基础上,通过外界刺激与主观意向的作用而后天习得的能力,比如语言、音乐、绘画、编程能力等,这一部分与生命体的意识息息相关,不同个体的差异可以非常大,是个体自由意志的体现。

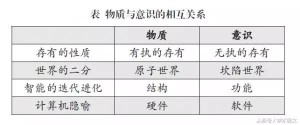

下表展示了物质与意识的相互关系。本质上,物质与意识两列在纵向上的概念是可以相互替代的,物质可以视作原子世界,也可以看成是构成智能的硬件,而意识(坎陷世界)作为软件,想要成功运行,发挥功能,必须在硬件平台之上。另外,具备功能的硬件一定具有非均匀(inhomogeneous)结构,在特定场景下一定会呈现出特定的功能,也就是软件的特征。动物的本能是一个例子,比如鸟长有翅膀决定了小鸟被亲鸟从高处推下后能够飞翔。

本能随着进化被嵌入基因而成为硬件的一部分,一旦被环境触发,其对应行为就会显现。例如动物的饥饿本能,以及由此衍生出的捕食者与被捕食者之间的追捕/逃亡本能。生物链环环相扣,每一物种都有其对应天敌足以说明这一点。

学习环节,因其最接近意识交流、最远离物质交换而属于软件,即信息除基因遗传方式外还可以通过社会学习途径传播。父母教育小孩或是小孩模仿父母的过程即可视作往人类大脑这一硬件中装入软件的过程。例如语言学习,小孩的母语完全取决于其成长所在的外部语言环境。

介于本能与学习环节之间的部分可被命名为先验,作为先于个人经验存在的部分以信息的形式储存在大脑硬件中,属于硬件与软件的中间状态,例如对空间与时间的直觉。

无论本能还是先验,对于生命个体而言,必须在能够区分自我与外部世界的前提下,在某一特定场景下受到外部因素对内部自我的刺激而产生应激反应,以此驱动自我对于内部软件进行调整,最终反馈为DNA信息链条中存储、传承下来的部分。

物质产生结构后,所展现出的功能即属于意识部分。因此,本能更接近物质属于硬件,学习环节则靠近意识属于软件。正如软件必须安装在硬件上才能运行,意识永远需要以物质作为平台才得以发挥其效用。

生命体的软件并没有程序员,“软件”的设计始于边界(细胞膜、认知膜或者皮肤),而后通过相互作用而丰富。相对于Dennett主张的自底向上式(bottom-up)的发展,自顶向下式(top-down)的设计思路更可能是正确的。智能进化的“软件/硬件”起源于边界(皮肤是初始的“自我”与“外界”的二元剖分),“自我”作为一个整体与“外界”进行交互,而后随着交互不断增多、不断细化,软件的设计也越来越多样。在能够区分自我与外部世界的前提下,外部因素对内部自我进行刺激以产生应激反应,驱动自我对于结构、功能进行调整。而结构本身是作为DNA信息链条中的一部分存储、传承下来的。

例如病毒,药物可以杀死病毒,但是病毒的调整也非常快。病毒是由一个核酸分子(DNA或RNA)与蛋白质构成的非细胞形态,靠寄生生活的介于生命体及非生命体之间的有机物种,它是没有细胞结构的特殊生物体,由一个保护性外壳包裹的一段DNA或者RNA,借由感染的机制,这些简单的有机体可以利用宿主的细胞系统进行自我复制,但无法独立生长和复制。病毒可以感染几乎所有具有细胞结构的生命体。通过药物的确可以杀死一部分病毒,但是新产生的病毒却可以具有抗药性。即病毒发生了变异,实际上就是其内部的结构发生了改变。因此病毒很难被完全杀死,相反其生存率非常之高。来自于外界的刺激就好像是为自我装了一个新软件,更有甚者在改写软件的同时也改写了硬件。

细菌亦是如此。正如朱永官所指出的,作为单细胞的生物,它们只要彼此相遇,就可能发生DNA交流,科学家称之为“基因横向转移”。它们也非常善变,特别是在化学污染物的“压力”下,会显著增加基因突变和横向转移的概率。细菌比人们想象的“聪明得多”。在新的环境下,它们能够通过基因横向转移和突变,快速获得适应性优势,从而“活下去”,并可能“进化”出药石罔效的“超级细菌”。

有意识AI的工程方案

有了对人类智能进化的结构/功能迭代机制,最近Bengio提出的意识先验模型就能改造成如下模型。有意识的AI是由一群智能体(agents)组成的小社会,智能体社会将呈现多样性(diversity)的特点,同时也具备社会性、群体性的特征。培养的方案就是使得智能体社会实现代际间功能与结构的进化。

I.对训练数据进行抽象,得到高级表征。从公式(1)出发,

ht=F(st,ht-1)(1)

可以从st得到高级表征ht,其中st为提供给t代的训练(观测)数据,ht为从st得到的高级表征。例如,ht可以是某些类型的RNN的输出,它读取st的序列作为输入,并在每个时间段产生一个输出ht。函数F是一个以RNN为基础的神经网络,ht是表征状态。对任何智能体而言,无论是像素点、频率或是压力,从感知到表征的第一步抽象都是必要的。第一步抽象只与感受器精度有关,感受器精度由硬件决定,可以认为对所有智能体的第一步抽象都是相同的。表征状态ht是一个非常高维的向量(如果想模仿生物学,这个结果可能是稀疏的),这是一个智能体可获得的完整的当前信息(超出存储在权重中的内容)的抽象表征,可以概括当前和近期的观察结果。

II.让不同的智能体针对同一有限数据集进行学习,智能体的特征、学习方式可以自由组合,达到尽量丰富的智能体学习的多样性。我们将意识状态cit定义为从ht导出的低维向量,它从ht中用注意力机制得出,并且将以前的意识状态为背景,Bengio的公式就被修改为

cit=C(ht,ci(t-1),yt)(2)

其中yt是某种形式的注意力机制,可以包含一个随机噪声源。这里有两点需要强调,第一点,因为自我肯定需求的存在,不同智能体的意识会产生差异,类似人类的性格不同;第二点,由于意识状态cit会与之前的意识状态ci(t-1)有关,提供表征的过程不同会使得智能体的意识状态不同,这就是说在无法穷尽所有可能的情况下,用相同的数据集进行训练,训练的过程不一样(数据提供的顺序)会导致智能体意识状态产生差异。这两点共同作用使得智能体能够呈现多样性的特点(用相同数据集训练会产生不同的网络结构)。

III.根据学习表现出来的独特性来选择优秀的智能体,而不是根据精确度来筛选。在步骤(II)中,针对Nt-1个智能体进行新一轮的训练,一个智能体有可能分裂变成多个,产生大于Nt-1个数的智能体,在此基础上来选择,选择出Nt个优秀智能体来替代Nt-1个智能体。

IV.将选择出来的智能体进行新一轮学习,用新的数据集重复I、II、III步骤。

有意识的AI模型将具有这样的优点,即有限的数量集就可以高效地达到相当高的训练效果,并且“天才”智能体能够把自己的经验教给别的智能体。以棋类为例,参考人类学棋的经验,人类学棋是有顺序的,先学规则、做死活题、由角到边到小棋盘、最后再到全盘大局的练习,这意味着学习的顺序与过程对结果是有影响的,数据的内容也是会有影响的,名家经典对局的棋谱就会比小孩随便乱走的棋谱更具有训练价值。在数据集的提供上,如果能够穷尽所有可能,那么所有的智能体都能得出目标问题的最优解,然而围棋的复杂性使得穷尽所有可能会是一种极大的浪费。AlphaGo学习初期经历过大量的棋谱数据学习,在学成之后进行自我对弈产生棋谱并再进行学习,给一个新的智能体以AlphaGo自我对弈的棋谱为数据集进行学习,新智能体提升的速度将会非常快,甚至反超AlphaGo(这是有可能的)。

例如,在人脸识别中,使用一个有限的训练集训练多个智能体,在训练中要求智能体生成人脸图像(这里可以使用GAN的部分),由于不同智能体意识层的差异,智能体对表征特征的关注会存在差异,所生成的人脸图片也会具有相应的特征差异,这种差异可能体现在耳朵鼻子眼睛这些人类可以理解的特征上,也可能是某些人类肉眼无法理解的特征,智能体却可以理解(这一点很关键),在第一轮训练完成后从中选出具有独特性的智能体(对不同的问题中独特性的判断将会不一样,在一些问题里准确性不会作为独特性判断的唯一标准,标准的定义将会有很多种),把它们生成的人脸图片进行一些处理(比如分块拼接,或者不处理)作为新的数据集。新数据集中将会具有更多对智能体而言明显的表征特征,这类似于围棋中经典的死活题与杂乱无章的摆放对孩童学棋起到的作用差异。用新数据集再继续训练多个智能体(可以是没训练的,也可以是第一阶段挑选出来的训练过的),重复这一过程,很可能得到能够生成逼真人脸图片的智能体(这些智能体生成的人脸图片甚至会有倾向上的差异),将这些“天才”智能体生成的图片作为数据集进行训练,即使是从未接触这一问题的智能体也可能很快“学习”人脸图片的特征(我们认为天才智能体生成的图片中具有更多更明显的表征特征),这个过程可以看作智能体间的学习。

人文学科的重要性

人工智能的发展已经带来了种种危机,而不管是禁止其发展还是对其进行监控,都不能彻底地解决问题。人类总是在不停尝试,寻求其他可能性,这是无法禁止的,人性本身即是如此,人类以自身为范本所缔造的人工智能自然亦是如此。然而问题在于,这诸多可能性本身之中即包含了许多不确定之因素,一旦开启即相当于为人类的未来埋下了定时炸弹。人类不能够总是一厢情愿地希冀人工智能会永远按照人类的设想行动,心存侥幸地认为人工智能不会做出违背人类利益之事。正如同人类世界中总是会出现乐于唱反调的人一样,人工智能也很可能如此,并且由于还存在诸多往往难以判断好坏对错的情况,人工智能的行为变得更加难以考量。所以现在需要做的就不是想方设法阻止这一天的到来。

作为万物之灵的人类存在的价值在哪里?生存还是毁灭,这是人类长久以来所思考的问题。当人工智能以超越人类的智慧步步逼近时,探寻全人类的未来之路刻不容缓。霍金等人论及哲学已死,那是完全从物理的角度来看待这个世界。但事实上,人类拥有自由意志,能够自我选择、自我决定。人们要建立何种道德体系,希望世界向何种方向发展,不由物理学决定,恰恰需要在哲学上讨论,人文学科在人工智能时代仍然至关重要。

AlphaGo的成绩已经证明,对确定目标的问题(有限游戏),机器一定会超越人类。但是由于自我肯定需求的作用,人类永远不会是单一的目标,而是一定会探索、思考新的内容。数学上看起来很小概率的事件中,人类往往能有意外发现,增加了世界的多样性。即便这些尝试没有导致成功,人类也不太可能会陷入其中,而是转而尝试其他可能。不断地尝试与创新,丰富世界的多样性,这就是人类的终极价值所在。虽然在计算与记忆等层面,机器可以远超人类,但是在对宇宙全局的意识层面,人类完全有能力同机器一起进化。

未来的超级智能正像一个智商很高的婴儿,需要父母对其进行道德、价值方面的引导,让其找到一个正确的方式来理解、对待这个世界,我们应当跳出科技本身,从人文的角度先为机器立心。

(武汉大学蔡天琪、汪临风、洪成晨、张璟昀、张文蔚、汪恺对此文有贡献)